随着信息技术的飞速发展,大数据已成为推动现代企业发展的关键引擎。高效的数据处理和存储支持服务,不仅能挖掘数据价值,还能提升决策精准度。本文将全面介绍如何玩转大数据开发工具,从数据处理到存储服务,提供完整的技术视角。

一、大数据开发工具概览

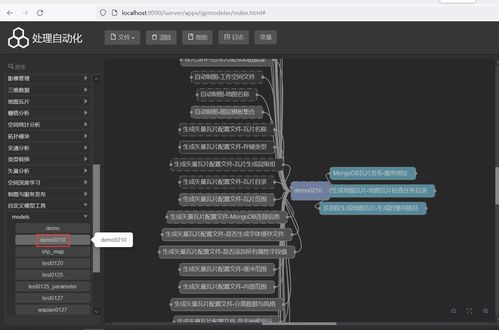

大数据开发工具是数据生态系统的核心,涵盖数据采集、清洗、转换和存储的各个环节。例如,Apache Hadoop和Apache Spark在分布式计算领域表现卓越,支持大规模数据处理;而Apache Kafka则专注于实时数据流处理,确保高效的数据摄取。这些工具的组合使用,能构建灵活且可扩展的数据处理流水线。

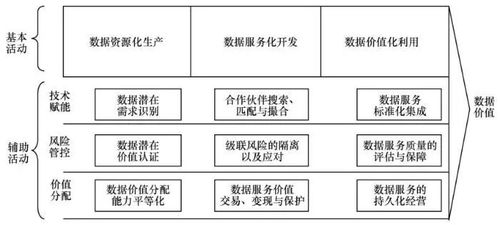

二、数据处理:从原始数据到洞察力

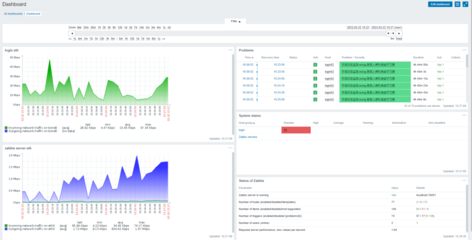

数据处理是大数据流程中的关键步骤,涉及数据清洗、ETL(提取、转换、加载)和数据分析。使用工具如Apache Spark,开发者可以快速执行复杂的数据转换,并利用其机器学习库进行预测建模。数据可视化工具如Tableau和Power BI,能将处理结果以直观方式呈现,帮助用户轻松获取洞察。实际应用中,企业可通过Spark Streaming处理实时数据,实现即时反馈,提升运营效率。

三、数据存储:构建可靠的数据仓库

数据存储是确保数据可用性和安全性的基础。传统关系型数据库如MySQL适合结构化数据,而大数据场景下,NoSQL数据库如MongoDB和Cassandra,以及分布式文件系统如HDFS,提供了高可扩展性和容错能力。云服务如AWS S3和Google BigQuery则提供弹性的存储解决方案,支持海量数据存取,并集成多种分析工具。通过合理选择存储方案,企业可以降低维护成本,同时确保数据长期可靠。

四、集成与优化:打造端到端数据服务

将数据处理与存储工具集成,能够构建端到端的数据支持服务。例如,使用Apache NiFi管理数据流,结合Hadoop和Spark进行批处理和实时分析,最后将结果存储到云数据库中。优化方面,关注性能调优和资源管理,如使用YARN进行集群调度,避免资源浪费。安全性和合规性也不可忽视,工具如Apache Ranger提供访问控制,保护数据隐私。

五、实践案例与未来趋势

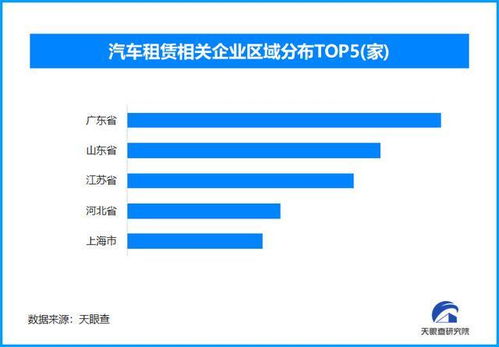

以电商行业为例,大数据工具可用于用户行为分析,通过Spark处理日志数据,存储于HBase,并利用可视化工具展示销售趋势。随着AI和边缘计算的兴起,大数据工具将更智能,支持更复杂的实时分析和异构数据源集成。开发者应持续学习新技术,例如学习云原生工具如Kubernetes,以适应不断演进的数据生态。

玩转大数据开发工具,需要全面掌握数据处理和存储的各个环节。通过合理选择和集成工具,企业能够释放数据潜力,驱动业务增长。记住,实践是关键——多动手实验,结合具体场景,才能真正成为大数据领域的专家。